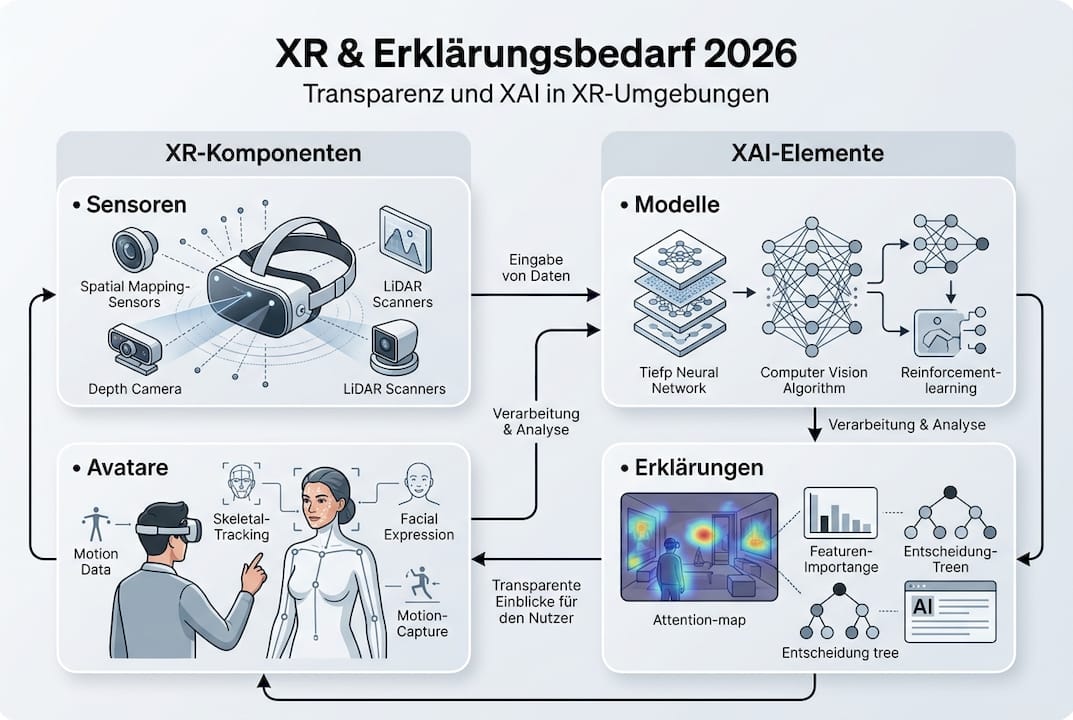

Während Extended Reality (XR) Trainingsumgebungen durch ihre immersive Kraft begeistern, übersehen viele Entscheider einen kritischen Erfolgsfaktor: den Erklärungsbedarf bei KI-gestützten Entscheidungen. Künstliche Intelligenz in AR-, VR- und Mixed-Reality-Anwendungen trifft kontinuierlich Entscheidungen über Lernpfade, Feedback und Anpassungen, doch die Nachvollziehbarkeit dieser Prozesse bleibt oft im Dunkeln. Diese fehlende Transparenz untergräbt das Vertrauen der Nutzer und kann trotz technischer Brillanz die Akzeptanz gefährden. Explainable AI (XAI) bietet hier den Schlüssel: Sie macht KI-Entscheidungen in XR-Technologien transparent und nachvollziehbar, sodass Lernende und Trainer verstehen, warum bestimmte Inhalte präsentiert oder Bewertungen vorgenommen werden.

Inhaltsverzeichnis

- Wichtigste Erkenntnisse zum Erklärungsbedarf in XR-Technologien

- Grundlagen und Erklärungsbedarf in XR-Technologien verstehen

- Methoden und Framework für erklärbare AI in XR-Umgebungen

- Praxis und Herausforderungen: Lernperformance, Engagement und Fehlerquellen

- Empfehlungen für Entscheider: XAI erfolgreich in XR implementieren

- Wie Amlogy Sie bei Erklärungsbedarf in XR unterstützen kann

- Häufige Fragen zum Erklärungsbedarf bei XR-Technologien

Wichtigste Erkenntnisse zum Erklärungsbedarf in XR-Technologien

| Punkt | Details |

|---|---|

| Erklärungsbedarf definiert | Bezieht sich auf die Nachvollziehbarkeit von KI-Entscheidungen in immersiven XR-Umgebungen, um Vertrauen zu schaffen. |

| Explainable XR Frameworks | Nutzen multimodale Analysen, LLM-gestützte Auswertungen und visuelle Interfaces für bessere Transparenz. |

| Engagement versus Performance | XR steigert Motivation deutlich, führt aber nicht automatisch zu verbesserter Lernleistung. |

| Fehlerquellen in XAI | Irreführende Erklärungen und Widersprüche können Nutzer verwirren, hybride Ansätze reduzieren Risiken. |

| Frühe Integration empfohlen | Entscheider sollten XAI von Beginn an einplanen und regulatorische Anforderungen wie den EU AI Act beachten. |

Grundlagen und Erklärungsbedarf in XR-Technologien verstehen

Der Begriff Erklärungsbedarf im Kontext von XR-Technologien beschreibt die Notwendigkeit, KI-gestützte Entscheidungen in immersiven Umgebungen transparent und nachvollziehbar zu gestalten. Während traditionelle Softwaresysteme oft mit einfachen Logs oder Dashboards auskommen, stellen XR-Anwendungen besondere Anforderungen: Nutzer sind vollständig in virtuelle oder erweiterte Welten eingetaucht, wo visuelle, auditive und haptische Reize gleichzeitig wirken. In solchen Umgebungen muss KI nicht nur korrekte Entscheidungen treffen, sondern diese auch so kommunizieren, dass Lernende oder Trainierende den Prozess verstehen und akzeptieren können.

Explainable AI in XR-Umgebungen zielt darauf ab, genau diese Transparenz zu schaffen. XAI-Methoden ermöglichen es, komplexe Algorithmen so darzustellen, dass menschliche Nutzer die Logik hinter Empfehlungen, Bewertungen oder adaptiven Lernpfaden nachvollziehen können. Für Unternehmen und Bildungsinstitutionen ist dies entscheidend: Ohne Vertrauen in die KI sinkt die Akzeptanz, selbst wenn die Technologie technisch einwandfrei funktioniert. Mitarbeiter oder Lernende, die nicht verstehen, warum ein System bestimmte Inhalte zeigt oder Feedback gibt, werden skeptisch und nutzen die Lösung weniger intensiv.

Immersive Umgebungen verstärken diese Herausforderung zusätzlich. In VR-Trainings für Sicherheitsszenarien etwa muss die KI in Echtzeit auf Nutzeraktionen reagieren und gleichzeitig erklären, warum bestimmte Warnungen oder Hinweise erscheinen. Anders als bei Desktop-Anwendungen können Nutzer nicht einfach ein separates Fenster öffnen, um Details nachzulesen. Erklärungen müssen direkt in die XR-Erfahrung integriert werden, ohne die Immersion zu stören oder kognitive Überlastung zu verursachen.

Warum XR besondere XAI-Ansätze erfordert:

- Multimodale Interaktion: Nutzer kommunizieren über Gesten, Blickrichtung, Sprache und Bewegung, was komplexe Datenströme erzeugt.

- Echtzeitanforderungen: Erklärungen müssen sofort verfügbar sein, da verzögerte Rückmeldungen die Lernerfahrung stören.

- Immersionserhalt: Erklärungen dürfen die immersive Erfahrung nicht unterbrechen, sondern müssen nahtlos integriert werden.

- Kontextabhängigkeit: In kollaborativen XR-Szenarien müssen Erklärungen für mehrere Nutzer gleichzeitig verständlich sein.

Für Entscheider bedeutet dies: Wer XR-Technologien erfolgreich implementieren will, muss den Erklärungsbedarf von Anfang an mitdenken. XAI ist kein nachträgliches Add-on, sondern ein integraler Bestandteil erfolgreicher XR-Trainings- und Lernlösungen.

Methoden und Framework für erklärbare AI in XR-Umgebungen

Moderne Frameworks für Explainable AI in XR-Kontexten kombinieren mehrere technische Komponenten, um Transparenz zu schaffen. Der User Action Descriptor (UAD) erfasst sämtliche Nutzerinteraktionen in der XR-Umgebung, von Blickbewegungen über Gesten bis hin zu Sprachbefehlen. Diese Daten werden dann durch Large Language Models (LLMs) analysiert, die natürlichsprachliche Erklärungen generieren können. Visuelle Interfaces präsentieren diese Erklärungen direkt im XR-Raum, etwa als schwebende Informationspanels oder eingeblendete Hinweise, die sich an die aktuelle Nutzeraktivität anpassen.

Explainable XR Frameworks nutzen diese Komponenten, um ein ganzheitliches System zu schaffen. Ein zentraler Vorteil liegt in der Modularität: Unternehmen können einzelne Komponenten je nach Bedarf austauschen oder erweitern. So lässt sich beispielsweise ein spezialisiertes LLM für medizinische Fachbegriffe integrieren, wenn XR-Trainings im Gesundheitswesen eingesetzt werden. Die Flexibilität ermöglicht es auch, unterschiedliche XR-Plattformen zu unterstützen, von reinen VR-Headsets bis hin zu AR-Brillen für industrielle Anwendungen.

Ein wichtiger Unterschied besteht zwischen AR-spezifischen XAI-Ansätzen (XAIR) und plattformübergreifenden Lösungen. XAIR fokussiert sich auf die besonderen Anforderungen von Augmented Reality, wo digitale Informationen mit der realen Welt verschmelzen. Hier müssen Erklärungen oft kontextsensitiv auf physische Objekte bezogen werden. Plattformübergreifende Frameworks hingegen bieten eine einheitliche XAI-Schicht für VR, AR und Mixed Reality, was die Wartung vereinfacht und Skalierung erleichtert.

Schritte zur Framework-Integration:

- Erfassen Sie alle relevanten Nutzerinteraktionen durch UAD-Komponenten.

- Definieren Sie Erklärungsziele: Welche KI-Entscheidungen müssen transparent werden?

- Wählen Sie passende LLM-Modelle für Ihre Fachdomäne aus.

- Gestalten Sie visuelle Interfaces, die Erklärungen ohne Immersionsverlust darstellen.

- Testen Sie mit echten Nutzern und iterieren Sie basierend auf Feedback.

| Framework-Typ | Stärken | Schwächen |

| — | — |

| UAD-basiert | Umfassende Datenerfassung, hohe Genauigkeit | Komplexe Implementierung, Datenschutzbedenken |

| LLM-gestützt | Natürliche Spracherklärungen, flexibel | Rechenintensiv, mögliche Halluzinationen |

| Visuelle XR-Interfaces | Immersiv, direkt verständlich | Designaufwand, Gefahr kognitiver Überlastung |

| XAIR (AR-spezifisch) | Kontextsensitiv für reale Objekte | Begrenzt auf AR-Anwendungen |

| Plattformübergreifend | Einheitliche Lösung für VR/AR/MR | Kompromisse bei plattformspezifischen Features |

Profi-Tipp: Starten Sie mit modularen Frameworks, die einzelne Komponenten austauschbar machen. So können Sie zunächst mit einfachen visuellen Erklärungen beginnen und später LLM-gestützte Analysen hinzufügen, ohne das gesamte System neu aufbauen zu müssen. Diese Flexibilität reduziert Risiken und ermöglicht schrittweise Investitionen.

Für erweiterte Realität in der Bildung sind solche Frameworks besonders wertvoll, da Lernende unterschiedliche Vorkenntnisse und Lernstile mitbringen. XAI kann hier personalisierte Erklärungen liefern, die auf das individuelle Niveau angepasst sind. Ein Framework, das diese Anpassung ermöglicht, steigert nicht nur die Akzeptanz, sondern auch die tatsächliche Lernwirksamkeit. Weitere Details zu erklärbaren KI-Frameworks in XR finden Sie in unseren spezialisierten Ressourcen.

Praxis und Herausforderungen: Lernperformance, Engagement und Fehlerquellen

Empirical studies zeigen ein differenziertes Bild: XR-Technologien steigern Motivation und Engagement der Lernenden deutlich, doch nicht zwingend die Lernperformance. Diese überraschende Erkenntnis hat wichtige Implikationen für Entscheider. Während Nutzer begeistert von immersiven Erfahrungen berichten und länger in VR-Trainings verweilen, führt dies nicht automatisch zu besserem Wissensaufbau oder verbesserten praktischen Fähigkeiten. Mehrere Faktoren tragen dazu bei: Kognitive Überlastung durch zu viele simultane Reize, Usability-Probleme bei der Navigation in 3D-Räumen und eben auch imperfekte XAI-Erklärungen, die Verwirrung stiften statt Klarheit zu schaffen.

Besonders problematisch sind Misleading Explanations, also irreführende Erklärungen, bei denen die KI zwar eine Begründung liefert, diese aber nicht die tatsächlichen Entscheidungsfaktoren widerspiegelt. Ein Beispiel: Ein VR-Sicherheitstraining gibt an, ein Nutzer habe einen Fehler gemacht, weil er zu langsam reagiert habe, obwohl die KI tatsächlich aufgrund einer ungünstigen Blickrichtung negativ bewertet hat. Solche Widersprüche untergraben das Vertrauen massiv. Nutzer lernen dann entweder die falschen Lektionen oder verlieren das Vertrauen in das gesamte System.

Weitere häufige XAI-Fehlerquellen umfassen:

- Widersprüchliche Erklärungen zwischen verschiedenen KI-Komponenten im selben System

- Zu technische oder zu abstrakte Erklärungen, die Nicht-Experten nicht verstehen

- Verzögerte Erklärungen, die nicht mehr zum aktuellen Kontext passen

- Fehlende Erklärungen in kritischen Momenten, wo Nutzer sie am meisten benötigen

Edge Cases verschärfen diese Probleme zusätzlich. In Multi-User-XR-Szenarien, wo mehrere Personen gleichzeitig in derselben virtuellen Umgebung trainieren, muss XAI Erklärungen liefern, die für alle Beteiligten gleichzeitig verständlich und relevant sind. Cross-Virtuality-Kontexte, bei denen Nutzer zwischen VR, AR und Desktop-Ansichten wechseln, erfordern adaptive Erklärungen, die sich an das jeweilige Medium anpassen. Hier versagen viele aktuelle Systeme noch.

“Trotz imperfekter Erklärungen bleibt Vertrauen in KI-gestützte XR-Systeme möglich, wenn Nutzer verstehen, dass das System transparent über seine Grenzen kommuniziert und kontinuierlich lernt.”

Diese Einsicht ist zentral: Perfektion ist nicht das Ziel, sondern ehrliche Transparenz. Systeme, die offen kommunizieren, wann sie unsicher sind oder warum bestimmte Erklärungen möglicherweise unvollständig sind, erzielen oft höhere Akzeptanz als solche, die vorgeben, alles perfekt zu erklären. Für XR-Technologien und Sicherheit ist diese Ehrlichkeit besonders wichtig, da Fehler in Sicherheitstrainings reale Konsequenzen haben können.

Entscheider sollten daher realistische Erwartungen setzen: XR mit XAI ist kein Wundermittel, sondern ein leistungsfähiges Werkzeug mit spezifischen Stärken und Schwächen. Die Kunst liegt darin, die Stärken zu maximieren und die Schwächen durch durchdachtes Design und hybride Ansätze zu minimieren.

Empfehlungen für Entscheider: XAI erfolgreich in XR implementieren

Die erfolgreiche Einführung von Explainable AI in XR-Trainingsumgebungen erfordert einen strukturierten Ansatz. Entscheider, die XAI in XR-Trainings integrieren, sollten mit überschaubaren Pilotprojekten beginnen und schrittweise skalieren. Dieser iterative Prozess ermöglicht es, Erfahrungen zu sammeln, ohne große Investitionen zu riskieren.

Schritte zur erfolgreichen XAI-Integration:

- Definieren Sie klare Anwendungsfälle: Identifizieren Sie konkrete Trainingsszenarien, wo Erklärbarkeit den größten Mehrwert bietet.

- Wählen Sie ein modulares Framework: Nutzen Sie Systeme, die Sie schrittweise erweitern können.

- Starten Sie mit einem Pilotprojekt: Testen Sie XAI zunächst in einem begrenzten Nutzerkreis.

- Messen Sie relevante Metriken: Erfassen Sie sowohl technische als auch nutzerzentrierte Kennzahlen.

- Iterieren Sie basierend auf Feedback: Passen Sie Erklärungen und Interfaces kontinuierlich an.

- Skalieren Sie schrittweise: Erweitern Sie erfolgreiche Ansätze auf weitere Trainingsmodule.

Besonders wichtig sind die richtigen Evaluationsmetriken. Human-reasoning Agreement misst, wie gut KI-Erklärungen mit menschlichem Verständnis übereinstimmen. Trust Scores erfassen, wie sehr Nutzer den KI-Entscheidungen vertrauen. Completion Rates zeigen, ob Lernende Trainings tatsächlich abschließen oder frustriert abbrechen. Diese Metriken sollten regelmäßig erfasst und analysiert werden, um Optimierungspotenziale zu identifizieren.

Hybride Lösungsansätze kombinieren XR mit traditionellen Desktop-Interfaces, um Komplexität zu reduzieren. Während immersive Trainingsszenarien in VR stattfinden, können detaillierte Analysen und Erklärungen auf einem separaten Bildschirm präsentiert werden. Dies reduziert kognitive Überlastung und ermöglicht es Nutzern, in ihrem eigenen Tempo zu lernen. Besonders für komplexe Sicherheitsszenarien, wo VR-Trainings kritische Fähigkeiten vermitteln, bietet dieser Ansatz Vorteile.

Regulatorische Vorgaben gewinnen zunehmend an Bedeutung. Der EU AI Act klassifiziert viele KI-Systeme in Trainings- und Bildungskontexten als Hochrisiko-Anwendungen, die strenge Transparenzanforderungen erfüllen müssen. Unternehmen sollten daher von Beginn an XAI-Komponenten einplanen, um spätere kostspielige Nachbesserungen zu vermeiden. Dokumentation der KI-Entscheidungsprozesse, regelmäßige Audits und nachweisbare Erklärbarkeit werden zur Pflicht.

Profi-Tipp: Nutzen Sie adaptive KI-Avatare als Erklärungs-Schnittstelle in VR-Trainings. Diese virtuellen Assistenten können Erklärungen personalisiert und kontextbezogen liefern, ohne die Immersion zu stören. Studien zeigen, dass menschenähnliche Avatare höhere Akzeptanz erzielen als abstrakte Texteinblendungen. Kombinieren Sie dies mit AR-Vorteilen im Geschäftsalltag, um auch mobile Trainingsszenarien abzudecken.

Abschließend gilt: XAI in XR ist eine Investition in langfristigen Erfolg. Systeme, die heute Transparenz und Vertrauen aufbauen, werden morgen höhere Akzeptanz, bessere Lernergebnisse und geringere Supportkosten erzielen. Entscheider, die diesen Weg konsequent gehen, positionieren ihre Organisation als Vorreiter in der digitalen Transformation von Training und Bildung.

Wie Amlogy Sie bei Erklärungsbedarf in XR unterstützen kann

Nach diesem umfassenden Überblick über Erklärungsbedarf und XAI in XR-Technologien stellt sich die praktische Frage: Wie setzen Sie diese Erkenntnisse konkret um? Amlogy bietet maßgeschneiderte Lösungen, die technische Exzellenz mit praxisnaher Umsetzbarkeit verbinden. Unsere XR-Trainingslösungen integrieren von Grund auf XAI-Komponenten, sodass Transparenz und Nachvollziehbarkeit keine nachträglichen Ergänzungen sind, sondern zentrale Designprinzipien.

Wir unterstützen Sie bei jedem Schritt: Von der initialen Bedarfsanalyse über die Konzeption passender XAI-Frameworks bis zur vollständigen Implementierung und kontinuierlichen Evaluierung. Unsere Expertise umfasst sowohl technische Aspekte wie UAD-Integration und LLM-Auswahl als auch didaktische Perspektiven, die sicherstellen, dass Erklärungen tatsächlich zum Lernerfolg beitragen. Besonders im Bereich VR-Sicherheitstrainings haben wir bewährte Best Practices entwickelt, die Vorteile von AR im Geschäftsalltag mit robusten XAI-Mechanismen kombinieren.

Für Bildungsinstitutionen bieten wir spezielle Pakete, die AR in der Bildung mit wissenschaftlich fundierten XAI-Ansätzen verbinden. Unternehmen profitieren von unserer Erfahrung in der Skalierung von Pilotprojekten zu unternehmensweiten Lösungen. Nutzen Sie unsere kostenlose Erstberatung, um zu erfahren, wie Best Practices für AR in der Bildung konkret in Ihrer Organisation umgesetzt werden können. Gemeinsam entwickeln wir XR-Trainings, die nicht nur technologisch beeindrucken, sondern messbare Lernerfolge erzielen.

Häufige Fragen zum Erklärungsbedarf bei XR-Technologien

Wie definiert sich Erklärungsbedarf in XR-Technologien?

Erklärungsbedarf in XR-Technologien bezeichnet die Notwendigkeit, KI-gestützte Entscheidungen in immersiven Umgebungen transparent und nachvollziehbar zu gestalten. Dies umfasst die Kommunikation, warum bestimmte Inhalte präsentiert, Bewertungen vorgenommen oder Lernpfade angepasst werden. Für mehr Details siehe unseren XR-Technologie Leitfaden.

Welche Vorteile bietet Explainable AI für Trainingsumgebungen?

Explainable AI steigert das Vertrauen der Nutzer in KI-gestützte Systeme erheblich, da sie verstehen, wie Entscheidungen zustande kommen. Dies führt zu höherer Akzeptanz, besserer Lernmotivation und reduzierten Supportanfragen. Zudem erfüllen XAI-Systeme regulatorische Anforderungen wie den EU AI Act, der Transparenz für Hochrisiko-Anwendungen vorschreibt.

Wie können Unternehmen XAI in XR effizient einführen?

Starten Sie mit einem klar definierten Pilotprojekt in einem spezifischen Trainingsbereich. Wählen Sie ein modulares Framework, das schrittweise erweitert werden kann, und messen Sie von Beginn an relevante Metriken wie Human-reasoning Agreement und Trust Scores. Iterieren Sie basierend auf Nutzerfeedback, bevor Sie skalieren. Hybride Ansätze, die XR mit Desktop-Interfaces kombinieren, reduzieren initiale Komplexität.

Welche Herausforderungen sind bei XAI in XR üblich?

Häufige Herausforderungen umfassen irreführende oder widersprüchliche Erklärungen, kognitive Überlastung durch zu viele simultane Informationen und technische Komplexität bei der Integration von UAD, LLMs und visuellen Interfaces. Edge Cases wie Multi-User-Szenarien oder Cross-Virtuality-Kontexte erfordern besondere Aufmerksamkeit. Realistische Erwartungen und transparente Kommunikation über Systemgrenzen helfen, diese Herausforderungen zu meistern.

Gibt es gesetzliche Vorgaben zur Erklärbarkeit von KI in XR?

Ja, der EU AI Act klassifiziert viele KI-Systeme in Trainings- und Bildungskontexten als Hochrisiko-Anwendungen, die strenge Transparenzanforderungen erfüllen müssen. Dies umfasst dokumentierte Entscheidungsprozesse, regelmäßige Audits und nachweisbare Erklärbarkeit. Unternehmen sollten XAI-Komponenten von Beginn an einplanen, um Compliance sicherzustellen und spätere kostspielige Anpassungen zu vermeiden.

Verbessert XR automatisch die Lernperformance?

Nein, XR steigert zwar Engagement und Motivation deutlich, führt aber nicht automatisch zu besseren Lernergebnissen. Usability-Probleme, kognitive Überlastung und imperfekte XAI-Erklärungen können die Lernwirksamkeit sogar reduzieren. Erfolgreiche XR-Trainings kombinieren immersive Technologie mit durchdachtem didaktischem Design und transparenten KI-Erklärungen, um tatsächliche Lernfortschritte zu erzielen.

Empfehlung

- 7 zentrale Trends in XR-Technologien 2026 für Sicherheit – Amlogy AR|VR

- Was bedeutet XR-Technologie? Leitfaden für Lernlösungen 2026 – Amlogy AR|VR

- Erweiterte Realität erklärt: Chancen für Bildung & Technik 2026 – Amlogy AR|VR

- Was ist erweiterte Realität? Vorteile für Bildung 2026 – Amlogy AR|VR