TL;DR:

- KI zeigt einen deutlichen Vorsprung bei Fairness-Konsistenz im Vergleich zu menschlichen Entscheidungen, was ethische Herausforderungen birgt.

- Entscheidungsprozesse sollten hybriden Ansatz verfolgen, bei dem KI Empfehlungen gibt und Menschen die finale Kontrolle behalten.

Wer glaubt, dass KI im Entscheidungsprozess nur eine nette Ergänzung ist, den überraschen die Zahlen gewaltig: KI-Modelle erzielen eine Fairness-Konsistenz von 80,73 %, während menschliche Entscheider bei vergleichbaren Aufgaben gerade einmal 56,32 % erreichen. Dieser Unterschied ist kein theoretischer Wert, sondern ein messbarer Vorsprung bei realen Hochschulzulassungen. Viele Führungskräfte unterschätzen dabei jedoch, dass mit diesem Potenzial auch erhebliche Haftungsrisiken, ethische Fallstricke und regulatorische Anforderungen einhergehen. Dieser Artikel gibt Ihnen eine praxisnahe Einordnung und klare Strategien für den souveränen Einsatz von KI-gestützten Entscheidungsprozessen in Ihrem Unternehmen.

Inhaltsverzeichnis

- Wesentliche Prinzipien KI-gestützter Entscheidungsprozesse

- Vergleich: Menschliche Urteilsfähigkeit vs. KI-Entscheidungen

- Regulatorische und ethische Herausforderungen für Unternehmen

- Praxisbeispiele und Aufbau sicherer KI-gestützter Strategien

- Warum KI-Entscheidungen Verantwortung nicht ersetzen dürfen

- Entdecken Sie KI- und AR-Lösungen für innovative Entscheidungsprozesse

- Häufig gestellte Fragen zur KI-gestützten Entscheidungsfindung

Wichtige Erkenntnisse

| Punkt | Details |

|---|---|

| KI steigert Fairness | KI-basierte Entscheidungsmodelle können nachweislich konsistentere und gerechtere Ergebnisse erzielen als reine Menschensysteme. |

| Haftungsrisiken steigen | Ab 2026 gelten strenge Haftungspflichten und hohe Bußgelder durch den AI Act bei Fehlentscheidungen durch KI. |

| Rahmenwerke sichern KI-Einsatz ab | Kontrollierte KI-Frameworks wie AugmentED und Explainable AI schützen vor Fehlern und schaffen Transparenz. |

| Menschliche Kontrolle bleibt essenziell | Auch die beste KI ersetzt keine menschliche Überprüfung; letztverantwortlich bleibt immer der Entscheidungsträger. |

Wesentliche Prinzipien KI-gestützter Entscheidungsprozesse

Nachdem die große Wirkung von KI in Entscheidungsprozessen skizziert wurde, folgt nun ein Blick auf die grundlegenden Funktionsprinzipien. Denn wer KI-basierte Entscheidungen strategisch einsetzen möchte, muss zunächst verstehen, auf welchen Methoden sie basieren.

Wie KI-Modelle Entscheidungen treffen

Moderne KI-Entscheidungssysteme beruhen hauptsächlich auf zwei technischen Ansätzen: klassischem maschinellem Lernen (Machine Learning) und großen Sprachmodellen, sogenannten LLMs (Large Language Models). Machine Learning-Modelle werden auf historischen Daten trainiert und erkennen darin Muster, die für neue Entscheidungen genutzt werden. Ein Beispiel aus der Praxis ist die automatisierte Bonitätsprüfung im Bankenwesen, wo Modelle auf Tausenden früherer Kreditentscheidungen trainiert werden.

LLMs wie GPT-4 oder vergleichbare Systeme gehen einen Schritt weiter: Sie analysieren Texte, formulieren Urteile und können in natürlicher Sprache Begründungen liefern. Das macht sie besonders interessant für strukturierte Auswahlprozesse, Bewerbungsanalysen oder Bildungsbewertungen. Allerdings zeigen Studien, dass LLMs bei Rückfallprognosen in 83 bis 87 % der Fälle mit menschlichen Entscheidungen übereinstimmen, aber gleichzeitig anfällig für irrelevante Daten und Störeinflüsse sind.

Das bedeutet konkret: Ein LLM, das über die Zulassung eines Studierenden entscheidet, kann durch sprachliche Nuancen im Bewerbungstext beeinflusst werden, die eigentlich keinerlei Relevanz haben. Die Grundlagen künstlicher Intelligenz zeigen, dass dieses Problem nicht gelöst wird, indem man die Technologie verbessert, sondern indem man robuste Kontrollsysteme etabliert.

Automatisierung vs. menschliches Urteil: Wo liegt die Grenze?

Die zentrale Frage für Entscheidungsträger lautet nicht „KI oder Mensch?“, sondern „Welchen Anteil übernimmt die KI, und wo muss der Mensch eingreifen?” Eine vollständig automatisierte Personalentscheidung ohne menschliche Überprüfung wäre heute nicht nur ethisch fragwürdig, sondern auch regulatorisch riskant.

Maschinelles Lernen kann Fairness steigern, ist aber nicht vor Störeinflüssen geschützt, was bedeutet, dass selbst gut trainierte Modelle systematische Verzerrungen reproduzieren können, wenn die Trainingsdaten entsprechend belastet sind. Das klassische Beispiel: Ein Recruiting-Algorithmus, der auf historischen Einstellungsdaten eines Unternehmens mit geringem Frauenanteil trainiert wurde, wird tendenziell männliche Kandidaten bevorzugen.

Wichtige Vorteile KI-gestützter Entscheidungen:

- Deutlich höhere Konsistenz bei wiederholten Entscheidungen unter gleichen Bedingungen

- Schnellere Verarbeitung großer Datenmengen, z. B. bei der Bewerberselektion

- Reduzierte kognitive Verzerrungen im Vergleich zu ermüdeten oder vorbelasteten menschlichen Beurteilern

- Skalierbarkeit: dieselbe Entscheidungsqualität für 100 oder 100.000 Fälle

Typische Herausforderungen in der Praxis:

- Intransparenz bei komplexen Modellen (Black-Box-Problem)

- Anfälligkeit für manipulative Eingaben und Datenqualitätsprobleme

- Fehlende Kontextsensitivität in ungewöhnlichen Situationen

- Übertragungsfehler zwischen Trainings- und Realdatensatz

Profi-Tipp: Starten Sie KI-Entscheidungsprojekte nie mit einem vollständigen Automatisierungsansatz. Beginnen Sie mit hybriden Modellen, bei denen KI Empfehlungen ausspricht und Menschen endgültig entscheiden. So bauen Sie Vertrauen auf und identifizieren Schwachstellen sicher.

Wer heute KI-Strategien für Wettbewerbsvorteile entwickelt, legt den Grundstein für nachhaltig überlegene Entscheidungsprozesse, egal ob in der Bildung oder im Unternehmensumfeld.

| Entscheidungsmodell | Stärke | Typisches Anwendungsfeld | Hauptrisiko |

|---|---|---|---|

| Machine Learning | Mustererkennung in Massendaten | Bonitätsprüfung, Qualitätssicherung | Verzerrte Trainingsdaten |

| LLMs | Sprach- und Textverarbeitung | Bewerbungsanalyse, Lernbewertung | Störanfälligkeit, Halluzinationen |

| Regelbasierte KI | Vorhersehbarkeit, Transparenz | Compliance, Buchhaltung | Fehlende Flexibilität |

| Hybridmodelle | Mensch und Maschine kombiniert | Personalentscheidungen, Zulassungen | Koordinationsaufwand |

Vergleich: Menschliche Urteilsfähigkeit vs. KI-Entscheidungen

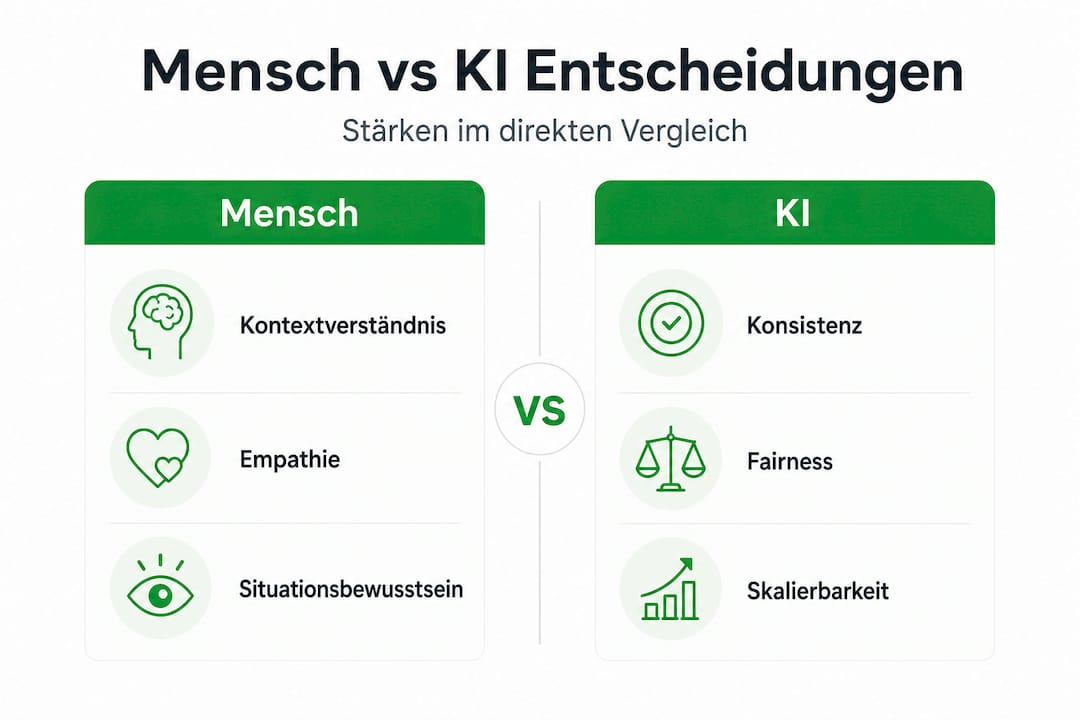

Die Prinzipien sind verstanden, nun lohnt ein differenzierter Vergleich zwischen Mensch und Maschine. Dieser Vergleich liefert keine eindeutige Siegerseite, sondern zeigt, dass beide Systeme unterschiedliche Stärken in unterschiedlichen Kontexten haben.

Was die Daten wirklich aussagen

Die Zahlen sind eindeutig, wenn man sie richtig interpretiert: Empirische Benchmarks zeigen deutlich höhere Fairness-Konsistenz bei KI (80,73 %) verglichen mit menschlicher Beurteilung (56,32 %). Das klingt nach einem klaren Vorteil für die Maschine. Doch dieser Befund gilt unter kontrollierten Bedingungen mit klar definierten Kriterien und strukturierten Datensätzen.

In echten Unternehmensumgebungen sieht die Realität anders aus. Menschen erkennen Kontexte, soziale Dynamiken und emotionale Nuancen, die kein aktuelles KI-System vollständig erfassen kann. Ein erfahrener HR-Manager bemerkt, wenn ein hervorragender Kandidat an einem schlechten Tag ins Bewerbungsgespräch kommt. Eine KI, die nur den Lebenslauf analysiert, sieht das nicht.

Besonders interessant ist dabei die Entdeckung des sogenannten Judgment-Action Gap: 47,6 % der LLMs revidieren im Nachhinein ihre Entscheidungen, auch wenn sie ursprünglich eine klare Empfehlung ausgegeben haben. Das bedeutet: Ein KI-System kann bei identischen Fällen zu unterschiedlichen Ergebnissen kommen, wenn es mehrfach befragt wird. Für rechtsrelevante Entscheidungen ist das ein ernstes Problem.

| Kriterium | Menschliches Urteil | KI-Entscheidung |

|---|---|---|

| Fairness-Konsistenz | 56,32 % | 80,73 % |

| Kontextsensitivität | Hoch | Begrenzt |

| Skalierbarkeit | Gering | Sehr hoch |

| Erklärbarkeit | Intuitiv | Technisch komplex |

| Flexibilität bei Ausnahmen | Sehr gut | Eingeschränkt |

| Regulatorische Compliance | Erfahrungsbasiert | Standardisierbar |

KI als Ergänzung, nicht als Ersatz

Die Botschaft für Führungskräfte ist klar: KI ist kein Ersatz für menschliche Urteilskraft, sondern eine kraftvolle Ergänzung. Das Zusammenspiel beider Systeme erzeugt nachweislich bessere Ergebnisse als jeder Ansatz alleine. Wir bei Amlogy nennen das den „augmentierten Entscheidungsprozess", bei dem technologische Präzision auf menschliche Empathie trifft.

Praktische Konsequenzen für Auswahlprozesse in Unternehmen:

- KI übernimmt die erste Screening-Runde bei großen Bewerberpools

- Menschliche Entscheider konzentrieren sich auf die qualitative Tiefenbewertung

- Hybride Dashboards zeigen KI-Empfehlung und menschliche Einschätzung parallel

- Finale Entscheidungen bleiben grundsätzlich beim Menschen

Interessant ist auch die Verbindung zum Bildungsbereich: Adaptives Lernen mit AR/VR zeigt, wie hybride Systeme auch in Lernumgebungen funktionieren. Die KI passt das Lerntempo an, der Lehrende behält die pädagogische Kontrolle. Dieses Modell lässt sich direkt auf Unternehmensumgebungen übertragen.

Für tiefergehende theoretische Grundlagen empfehlen sich strukturierte Ansätze wie die AugmentED- und CIDDL-Frameworks, die systematisch beschreiben, wo KI Entscheidungen unterstützen darf und wo die menschliche Kontrolle essenziell bleibt.

Regulatorische und ethische Herausforderungen für Unternehmen

Nachdem Stärken und Schwächen deutlich geworden sind, betrachten wir die gesetzlichen und ethischen Rahmenbedingungen. Denn wer KI ohne regulatorisches Wissen einsetzt, riskiert nicht nur schlechte Entscheidungen, sondern ernsthafte rechtliche Konsequenzen.

Der AI Act und seine Auswirkungen

Europa hat mit dem AI Act den weltweit ersten umfassenden Rechtsrahmen für künstliche Intelligenz geschaffen. Was das konkret für Ihr Unternehmen bedeutet, ist vielen Führungskräften noch nicht vollständig bewusst. Der AI Act bringt ab August 2026 Haftungsrisiken und Bußgelder von bis zu 7 % des Jahresumsatzes für Geschäftsführer beim Einsatz von Hochrisiko-KI mit sich. Das ist keine abstrakte Bedrohung, das ist geltendes Recht.

„Wer KI-Systeme in Hochrisikobereichen wie Personalentscheidungen, Bildungszugang oder Kreditvergabe einsetzt, ohne die vorgeschriebenen Dokumentations-, Transparenz- und Prüfpflichten zu erfüllen, handelt ab August 2026 direkt gesetzeswidrig."

Hochrisiko-KI im Sinne des AI Act umfasst unter anderem Systeme, die bei Bewerbungen eingesetzt werden, Entscheidungen im Bildungsbereich treffen oder sicherheitskritische Infrastrukturen steuern. Gerade für Bildungseinrichtungen und Technologieunternehmen ist dieser Punkt zentral.

Die drei Kernbereiche ethischer Verantwortung

Ethische Verantwortung im KI-Einsatz lässt sich auf drei Kernbereiche reduzieren, die für Entscheidungsträger handlungsleitend sein sollten:

-

Transparenz: Betroffene Personen haben ein Recht zu wissen, dass eine KI an ihrer Beurteilung beteiligt war. Sie haben auch das Recht auf eine verständliche Erklärung. Systeme ohne Erklärbarkeit sind im Hochrisikobereich nicht mehr zulässig. Die Möglichkeiten, die KI in der Weiterbildung bietet, zeigen, wie Transparenz aktiv als Qualitätsmerkmal kommuniziert werden kann.

-

Nicht-Diskriminierung: KI-Systeme dürfen keine Gruppen aufgrund von Merkmalen wie Geschlecht, Herkunft oder Alter systematisch benachteiligen. Die Verantwortung dafür liegt beim Unternehmen, das die KI einsetzt, nicht beim Softwareanbieter.

-

Fehlermanagement: Kein System ist fehlerfrei. Unternehmen brauchen klare Prozesse, wie mit KI-Fehlentscheidungen umgegangen wird, wie sie erkannt und wie Betroffene entschädigt werden.

Profi-Tipp: Führen Sie ein KI-Risikoinventar ein, bevor Sie neue Systeme deployen. Dokumentieren Sie jeden Anwendungsfall, ordnen Sie ihn einer Risikoklasse zu und definieren Sie Zuständigkeiten. Diese einfache Maßnahme schützt Sie rechtlich und schärft intern das Bewusstsein für Verantwortlichkeiten.

Für eine kritische wissenschaftliche Einordnung lohnt sich der Blick auf Regulatorik und Kritik am AI Act, der zeigt, wo Experten die Grenzen des aktuellen Rechtsrahmens sehen. Außerdem zeigt ein praktisch erprobter Use Case: KI für VR-Training, wie regulatorisch sichere Implementierungen in immersiven Lernumgebungen aussehen können.

Praxisbeispiele und Aufbau sicherer KI-gestützter Strategien

Von regulatorisch-ethischen Herausforderungen geht es nun zur konkreten Umsetzung fundierter und sicherer KI-Strategien. Denn das Wissen um Risiken ist wertvoll, aber erst der strukturierte Aufbau macht KI-Projekte wirklich erfolgreich.

AugmentED und CIDDL: Zwei bewährte Frameworks

Zwei Frameworks haben sich in Bildungs- und Technologieprojekten besonders bewährt: AugmentED und CIDDL. Frameworks wie AugmentED und CIDDL koppeln personalisierte Lernunterstützung mit klaren Grenzen für KI-Entscheidungen, was sie zu einem Vorbild für verantwortungsvolle KI-Implementierung macht.

AugmentED ist ursprünglich für Bildungskontexte entwickelt worden und definiert klare Rollen: Die KI übernimmt die Datenanalyse, die Lernpfadoptimierung und die Fortschrittsmessung. Lehrende und Koordinatoren behalten Entscheidungshoheit über pädagogische Weichenstellungen. CIDDL (Curriculum-Informed Data-Driven Learning) ergänzt diesen Ansatz um curriculare Qualitätsstandards und stellt sicher, dass KI-Empfehlungen innerhalb definierter Lernziele bleiben.

Beide Frameworks lassen sich auf Unternehmensumgebungen übertragen. Ersetzen Sie „Lernpfad" durch „Mitarbeiterentwicklung" und „curriculare Standards" durch „Unternehmensrichtlinien", und das Prinzip bleibt dasselbe: KI unterstützt, der Mensch entscheidet.

Phasen einer sicheren KI-Implementierung

Der Aufbau eines sicheren KI-Entscheidungssystems folgt einem klaren Ablauf, den wir aus unserer Projekterfahrung heraus empfehlen:

| Phase | Ziel | Schlüsselaktivitäten | Erfolgskriterium |

|---|---|---|---|

| 1. Bedarfsanalyse | Anwendungsfall definieren | Workshops, Stakeholder-Interviews | Klarer Scope und Risikoeinstufung |

| 2. Datenaudit | Datenqualität sichern | Bias-Analyse, Datenbereiniging | Dokumentierter Datensatz |

| 3. Modellauswahl | Passendes KI-Modell wählen | Proof of Concept, Benchmarking | Nachgewiesene Baseline-Performance |

| 4. Kontrolldesign | Menschliche Aufsicht einbauen | Review-Prozesse, Eskalationspfade | Festgelegte Entscheidungsgrenzen |

| 5. Deployment | Live-Betrieb starten | Pilotbetrieb, Monitoring | Einhaltung KPIs und Compliance |

| 6. Optimierung | Kontinuierlich verbessern | Feedbackschleifen, Audits | Messbare Qualitätssteigerung |

Checkliste für Führungskräfte vor dem KI-Einsatz:

- Ist der Anwendungsfall dem AI Act entsprechend risikoklassifiziert?

- Sind Trainingsdaten auf Verzerrungen geprüft worden?

- Gibt es einen klaren Eskalationspfad für KI-Fehler?

- Sind Betroffene über den KI-Einsatz informiert?

- Liegt ein Transparenz- und Erklärbarkeitskonzept vor?

- Wurden Mitarbeitende geschult, KI-Empfehlungen kritisch zu hinterfragen?

Transparenz durch Explainable AI ist dabei kein optionales Feature, sondern ab 2026 eine regulatorische Grundvoraussetzung. Und smarte Lernumgebungen zeigen, wie KI, AR und VR zusammengebracht werden können, um nicht nur Entscheidungen zu unterstützen, sondern auch Kompetenzentwicklung immersiv zu gestalten.

Wer weiterführende Orientierung sucht, findet in den Best Practices für KI-Entscheidungen einen strukturierten Überblick über bewährte Methoden für strategisch kluge Entscheidungsprozesse.

Warum KI-Entscheidungen Verantwortung nicht ersetzen dürfen

Nach dem praxisorientierten Aufbau sicherer KI-Entscheidungssysteme möchten wir eine kritische Reflexion teilen, die uns aus unserer eigenen Projektarbeit wichtig erscheint. Es ist die Beobachtung, die wir immer wieder machen: Selbst gut implementierte KI-Systeme können menschliche Verantwortung aushöhlen, ohne dass irgendjemand das bewusst beabsichtigt.

Wie passiert das? Wenn ein KI-System zuverlässig funktioniert, beginnen Menschen, seine Empfehlungen nicht mehr zu hinterfragen. Das ist psychologisch völlig nachvollziehbar. Warum sollte man eine Entscheidung anzweifeln, die statistisch gesehen richtig ist? Genau hier liegt die Gefahr. Effizienzgewinne durch KI führen bei mangelnder Kontrolle zu Erosion menschlicher Verantwortung, sogar dann, wenn Aufsichtsmechanismen formal vorhanden sind.

Wir nennen das das „Rubber-Stamp-Problem": Der Mensch ist technisch noch im Prozess, aber faktisch nur noch Stempel. Die Entscheidung hat die KI getroffen, der Mensch hat sie ratifiziert. Im Fehlerfall ist dann unklar, wer wirklich Verantwortung trägt. Gerichte werden diese Frage in den kommenden Jahren grundlegend beschäftigen.

Was zeigen unsere Projekterfahrungen? In Bildungsprojekten, wo KI Lernpfade empfiehlt, sehen wir regelmäßig, dass Lehrende ihre eigene pädagogische Einschätzung zurückstellen, sobald ein KI-Dashboard eine alternative Route vorschlägt. Das ist keine schlechte Absicht, sondern eine natürliche Reaktion auf Autorität durch Algorithmen.

Die Lösung liegt nicht darin, KI zu misstrauen oder ihre Vorteile zu ignorieren. Wir glauben fest daran, dass KI transformatives Potenzial hat. Die Lösung liegt in einer aktiven Kultur der KI-Kritikalität: Entscheidungsträger müssen befähigt werden, KI-Empfehlungen systematisch zu hinterfragen, Abweichungen zu dokumentieren und Verantwortung explizit zu übernehmen. Das ist kein Widerspruch zur Effizienz, das ist ihre Voraussetzung.

Wer die Technologietrends im Business 2026 verfolgt, sieht: Die erfolgreichsten Unternehmen sind nicht jene, die KI am schnellsten einführen, sondern jene, die Verantwortungsstrukturen und Technologie gemeinsam entwickeln. KI-Exzellenz und menschliche Integrität sind kein Widerspruch. Sie bedingen einander.

Entdecken Sie KI- und AR-Lösungen für innovative Entscheidungsprozesse

Sie wissen jetzt, worauf es ankommt: faire KI-Modelle, klare Kontrollmechanismen und Frameworks, die Technologie und menschliche Verantwortung intelligent verbinden. Genau das ist der Kern unserer Arbeit bei Amlogy. 🚀

Wir entwickeln maßgeschneiderte AR-, VR- und KI-Lösungen, die Entscheidungsprozesse in Bildungseinrichtungen und Unternehmen auf ein neues Level heben. Ob immersive VR-Trainingsumgebungen für Sicherheitsszenarien, adaptives Lernen mit KI-Unterstützung oder strategische Technologiebewertungen: Wir begleiten Sie von der ersten Idee bis zur sicheren Umsetzung. Schauen Sie sich an, wie Sie AR-Lösungen Schritt für Schritt umsetzen können, entdecken Sie die Möglichkeiten von KI in der Weiterbildung oder erfahren Sie, wie Transformation durch AR/VR Ihre Lern- und Entscheidungskultur nachhaltig verändert. Lassen Sie uns gemeinsam Ihre Vision in die Realität bringen 👇

Häufig gestellte Fragen zur KI-gestützten Entscheidungsfindung

Welche Vorteile bietet KI-basierte Entscheidungsfindung in Bildung und Technologie?

KI erhöht nachweislich die Fairness und Konsistenz von Entscheidungen und kann Prozesse automatisieren sowie individuell anpassen. Empirische Benchmarks belegen höhere Fairness-Konsistenz bei KI von 80,73 % gegenüber 56,32 % bei menschlicher Beurteilung.

Welche Risiken bestehen beim Einsatz von KI für geschäftskritische Entscheidungen?

Neben algorithmischer Verzerrung und Anfälligkeit für Manipulation drohen durch den AI Act ab August 2026 erhebliche rechtliche Konsequenzen. Der AI Act bringt Haftungsrisiken bis 7 % des Jahresumsatzes für Unternehmen, die Hochrisiko-KI unkontrolliert einsetzen.

Wie stellen Unternehmen sicher, dass KI-Entscheidungen transparent und nachvollziehbar sind?

Sie nutzen Frameworks wie AugmentED oder Explainable AI, um den Entscheidungsprozess offen zu legen und menschlich zu kontrollieren. AugmentED koppelt KI-Entscheidungen an kontrollierte Rahmenbedingungen und definiert klare Grenzen für automatisierte Urteile.

Ersetzt KI in Unternehmen vollständig menschliche Verantwortung?

Nein. KI übernimmt eine unterstützende Rolle, während Verantwortung und Kontrolle zentral beim Menschen verbleiben. Effizienzgewinne dürfen menschliche Verantwortung nicht verdrängen, auch wenn Kontrollmechanismen formal vorhanden sind.

Empfehlung

- Technologie strategisch nutzen: Training und Bildung transformieren – Amlogy AR|VR

- Digitale Innovationstipps: AR und VR in Lernprozesse 2026 – Amlogy AR|VR

- Warum KI für Startups 2026 unverzichtbar ist – Amlogy AR|VR

- Strategische Technologiebewertung für AR, VR und KI im Training – Amlogy AR|VR